Orașele din Norvegia în care trăiesc cei mai mulți români

Norvegia, una dintre cele mai dezvoltate țări din Europa, a devenit o destinație atrăgitoare pentru mulți români în căutarea unor oportunități mai bune de muncă și trai. După aderarea României…

Ce trebuie să știe românii din Austria despre sistemul de sănătate din această țară

Pentru românii care s-au stabilit în Austria, adaptarea la sistemul de sănătate al țării este un pas esențial pentru asigurarea unei vieți mai bune. Austria este renumită pentru sistemul său…

Top 5 alimente tradiționale românești pe care le poți prepara ușor în străinătate

Dorul de acasă se simte cel mai intens în momentele simple: o sărbătoare fără sarmale, o dimineață de weekend fără miros de cozonac sau o seară rece fără o ciorbă…

Câți români sunt în diaspora

Diaspora românească reprezintă o componentă semnificativă a populației României, cu un impact major asupra țării de origine. Conform datelor oficiale recente ale Ministerului Afacerilor Externe, aproximativ 5,7 milioane de români…

Cum pot beneficia de pensie românii care au lucrat în Germania

Tot mai mulți români au ales să muncească în străinătate, iar Germania este una dintre principalele destinații pentru muncitorii români. O întrebare frecventă în rândul acestora este legată de drepturile…

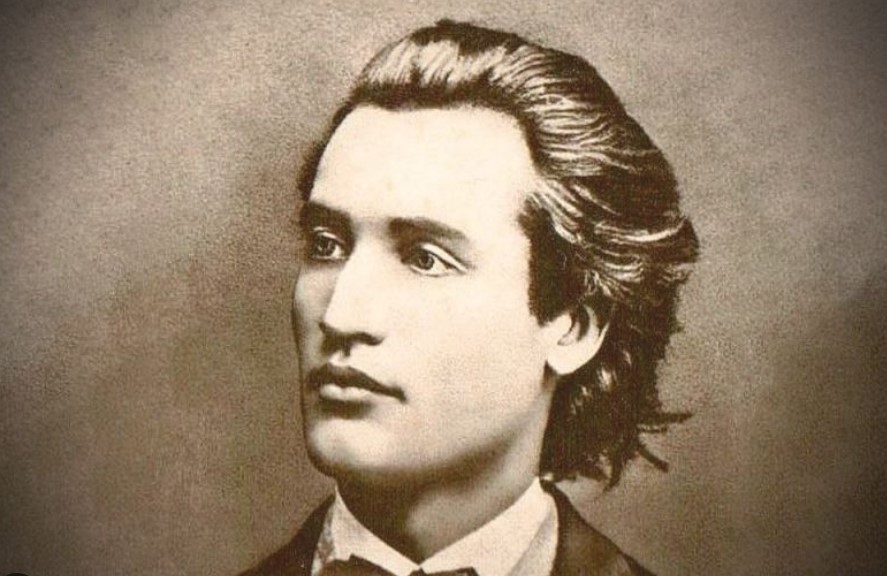

Români celebri care au studiat la Viena

Viena, capitala Austriei, a fost timp de secole un centru cultural și educațional major în Europa Centrală. Orașul a atras numeroși tineri români care, în căutarea cunoașterii și a desăvârșirii…

Obiceiuri și tradiții din Austria pe care românii trebuie să le cunoască dacă se mută în această țară

Austria este o destinație preferată de mulți români care aleg să se stabilească acolo, fie pentru oportunități profesionale, fie pentru un trai mai bun. Cu o cultură și o istorie…

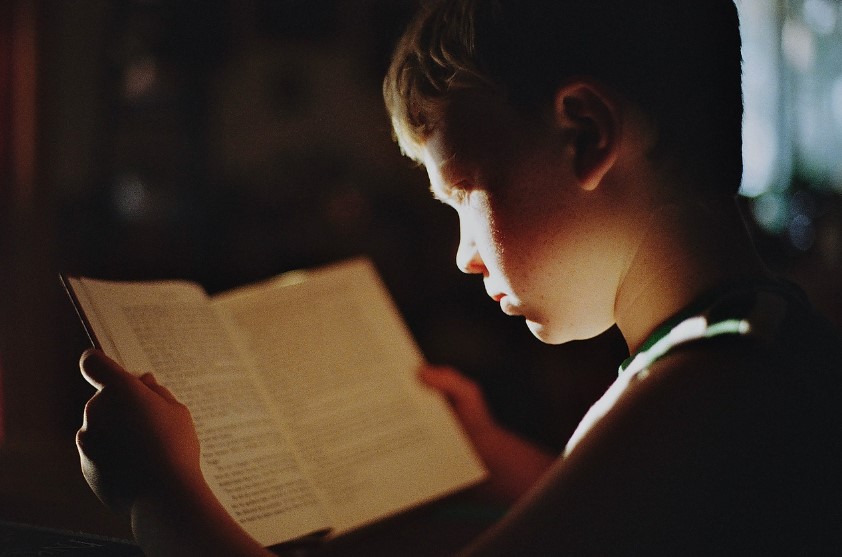

Educația copiilor români în diaspora: provocări și soluții

Pentru sute de mii de familii de români stabilite în străinătate, una dintre cele mai mari preocupări este legată de educația copiilor. Integrarea într-un nou sistem școlar, diferențele de limbă…

Ce trebuie să știi despre dublă impozitare și evitarea ei în diaspora: Ghid pentru românii care lucrează în străinătate

Pentru românii care lucrează, studiază sau au afaceri în afara țării, una dintre cele mai frecvente întrebări este: „Trebuie să plătesc impozit și în România, și în țara în care…

Cum să îți alegi o școală pentru copii în țările UE

Plecarea într-o țară străină vine cu numeroase provocări, iar una dintre cele mai importante pentru părinți este alegerea unei școli potrivite pentru copii. Sistemele educaționale diferă de la o țară…